En contexto: La inteligencia artificial general (AGI) se refiere a la IA capaz de expresar habilidades de razonamiento similares a las humanas o incluso sobrehumanas. También conocida como «IA fuerte», la AGI eliminaría cualquier IA «débil» actualmente disponible en el mercado y daría inicio a una nueva era de la historia de la humanidad.

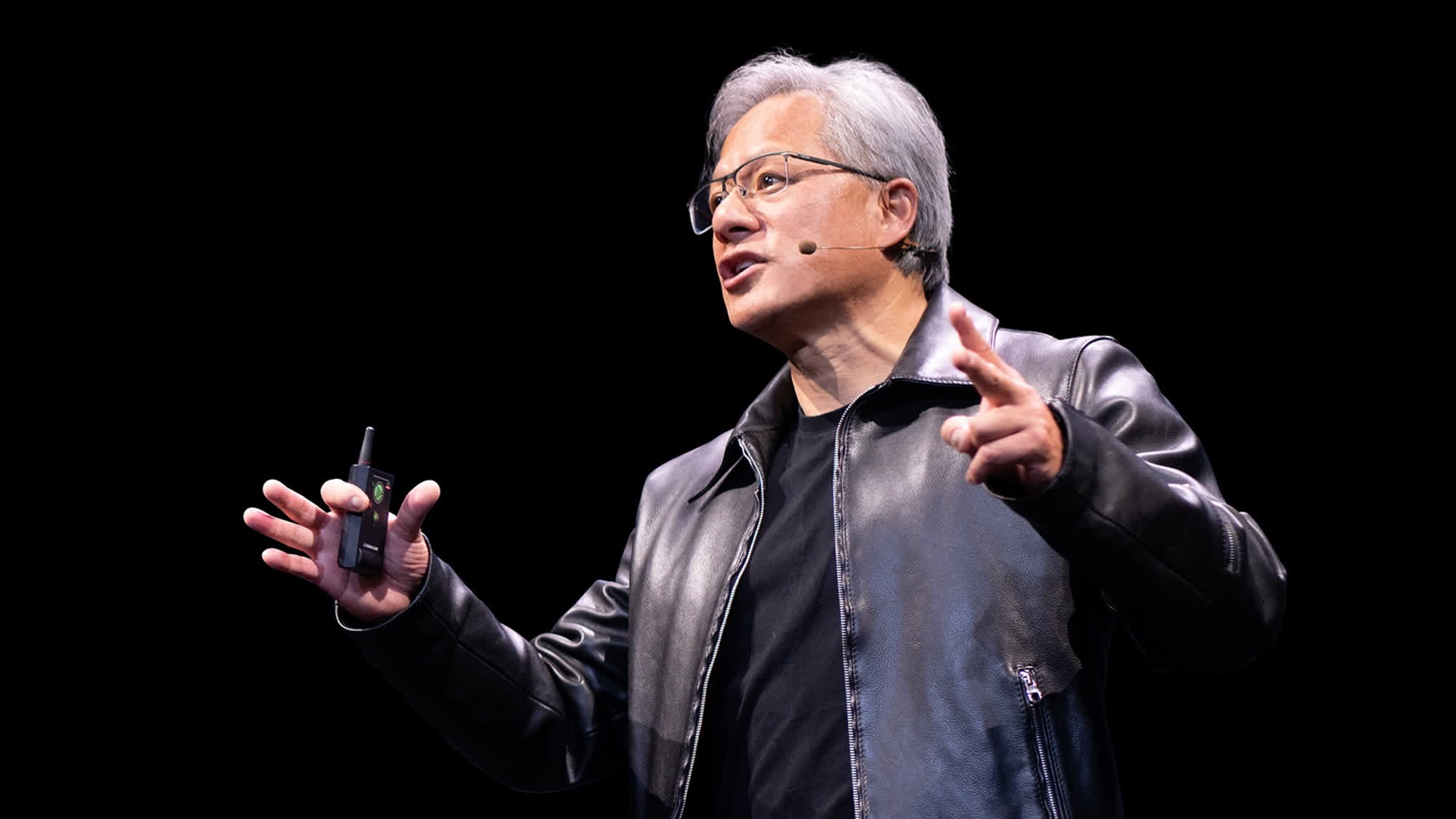

Durante la Conferencia sobre tecnología GPU de este año, Jensen Huang habló sobre el futuro de la tecnología de inteligencia artificial. Nvidia diseña la inmensa mayoría de las GPU y los chips aceleradores de IA que se utilizan en la actualidad, y la gente suele preguntar al director ejecutivo de la empresa sobre la evolución de la IA y las perspectivas futuras.

Además presentando la arquitectura de GPU Blackwell y los nuevos «superchips» B200 y GB200 para aplicaciones de IA, Huang habló sobre AGI con la prensa. La «verdadera» inteligencia artificial ha sido el tema de la ciencia ficción moderna durante décadas. Muchos piensan que la singularidad llegará más temprano que tarde ahora que los servicios menores de IA son tan baratos y accesibles al público.

Huang cree que dentro de cinco años llegará algún tipo de AGI. Sin embargo, la ciencia aún tiene que definir con precisión la inteligencia artificial general. Huang insistió en que acordáramos una definición específica de AGI con pruebas estandarizadas diseñadas para demostrar y cuantificar la «inteligencia» de un programa de software.

Si un algoritmo de IA puede completar tareas «un ocho por ciento mejor que la mayoría de las personas», podríamos proclamarlo como un competidor definitivo de AGI. Huang sugirió que las pruebas AGI podrían incluir exámenes de abogados, acertijos de lógica, pruebas económicas o incluso exámenes previos a la medicina.

Los abucheos de Nvidia no llegaron a predecir cuándo, o si, podría llegar un algoritmo de razonamiento humano, aunque los miembros de la prensa continuamente le hacen esa misma pregunta. Huang también compartió sus pensamientos sobre las «alucinaciones» de la IA, un problema importante de los algoritmos de aprendizaje automático modernos donde los chatbots responden de manera convincente a consultas con aire caliente (digital) sin fundamento.

Huang cree que las alucinaciones se pueden evitar fácilmente obligando a la IA a hacer su debida diligencia en cada respuesta que proporciona. Los desarrolladores deberían agregar nuevas reglas a sus chatbots, implementando «generación de recuperación aumentada.» Este proceso requiere que la IA compare los hechos descubiertos en la fuente con las verdades establecidas. Si la respuesta resulta ser engañosa o inexistente, debe descartarse y reemplazarse con la siguiente.