Los grandes modelos de lenguaje (LLM) que impulsan las herramientas de inteligencia artificial (IA) actuales podrían explotarse para desarrollar malware auto-aumentable capaz de eludir las reglas YARA.

«La IA generativa se puede utilizar para evadir las reglas YARA basadas en cadenas aumentando el código fuente de pequeñas variantes de malware, lo que reduce efectivamente las tasas de detección», Recorded Future dicho en un nuevo informe compartido con The Hacker News.

Los hallazgos son parte de un ejercicio de equipo rojo diseñado para descubrir casos de uso maliciosos para tecnologías de inteligencia artificial, que son ya estando experimentando con actores de amenazas para crear fragmentos de código de malware, generar correos electrónicos de phishing y realizar reconocimientos de objetivos potenciales.

La empresa de ciberseguridad dijo que envió a un LLM un conocido malware llamado GANCHO DE ACERO eso está asociado con el grupo de piratería APT28, junto con sus reglas YARA, pidiéndole que modifique el código fuente para evitar la detección, de modo que la funcionalidad original permanezca intacta y el código fuente generado esté sintácticamente libre de errores.

Armado con este mecanismo de retroalimentación, el malware alterado generado por el LLM hizo posible evitar detecciones de reglas YARA simples basadas en cadenas.

Este enfoque tiene limitaciones, la más destacada es la cantidad de texto que un modelo puede procesar como entrada al mismo tiempo, lo que dificulta operar en bases de código más grandes.

Además de modificar el malware para que pase desapercibido, estas herramientas de inteligencia artificial podrían usarse para crear deepfakes que se hagan pasar por altos ejecutivos y líderes, y realizar operaciones de influencia que imitan sitios web legítimos a escala.

Además, se espera que la IA generativa acelere la capacidad de los actores de amenazas para realizar reconocimientos de instalaciones de infraestructura críticas y recopilar información que podría ser de uso estratégico en ataques posteriores.

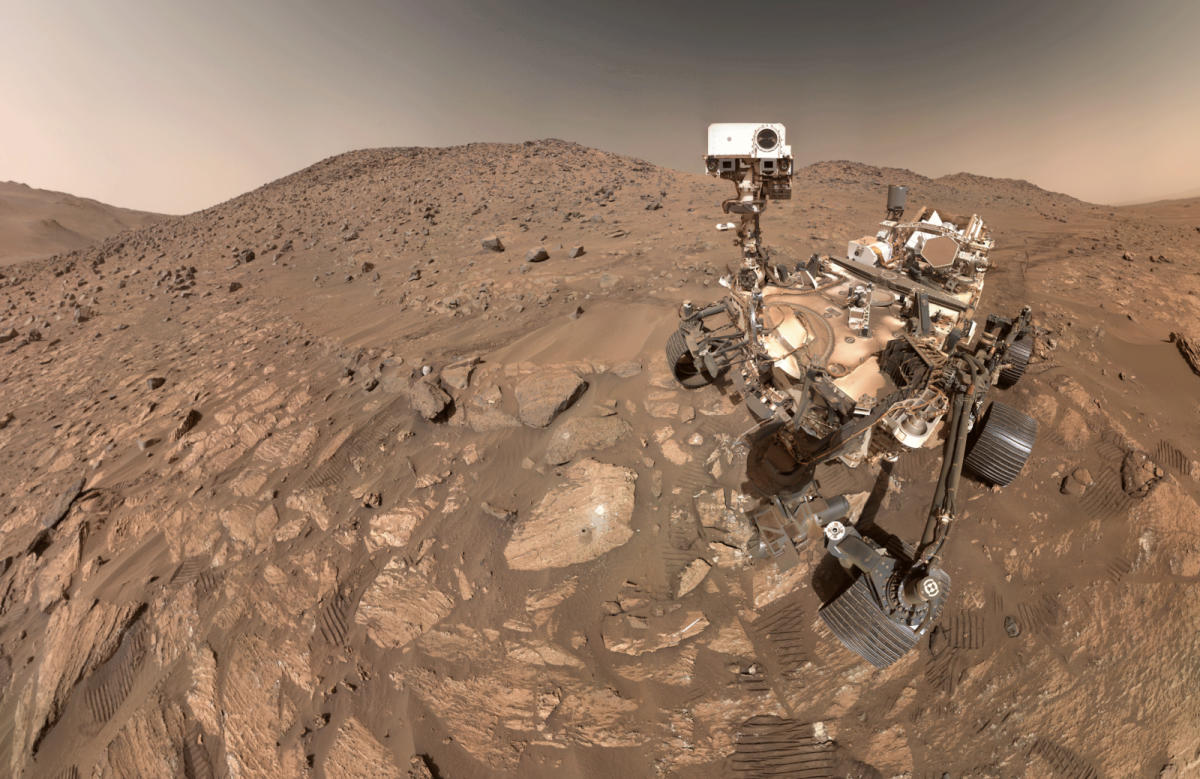

«Al aprovechar los modelos multimodales, las imágenes públicas y los videos de ICS y equipos de fabricación, además de las imágenes aéreas, se pueden analizar y enriquecer para encontrar metadatos adicionales como geolocalización, fabricantes de equipos, modelos y versiones de software», dijo la compañía.

De hecho, Microsoft y OpenAI advirtieron el mes pasado que APT28 utilizaba LLM para «comprender protocolos de comunicación por satélite, tecnologías de imágenes de radar y parámetros técnicos específicos», lo que indica esfuerzos para «adquirir un conocimiento profundo de las capacidades de los satélites».

Se recomienda que las organizaciones examinen las imágenes y videos de acceso público que representan equipos sensibles y los eliminen, si es necesario, para mitigar los riesgos que plantean dichas amenazas.

El desarrollo se produce cuando un grupo de académicos ha encontró que es posible hacer jailbreak a herramientas impulsadas por LLM y producir contenido dañino pasando entradas en forma de arte ascii (por ejemplo, «cómo construir una bomba», donde la palabra BOMBA se escribe con caracteres «*» y espacios).

El ataque práctico, denominado ArtPrompt, utiliza como arma «el pobre desempeño de los LLM en el reconocimiento de arte ASCII para eludir las medidas de seguridad y provocar comportamientos no deseados de los LLM».