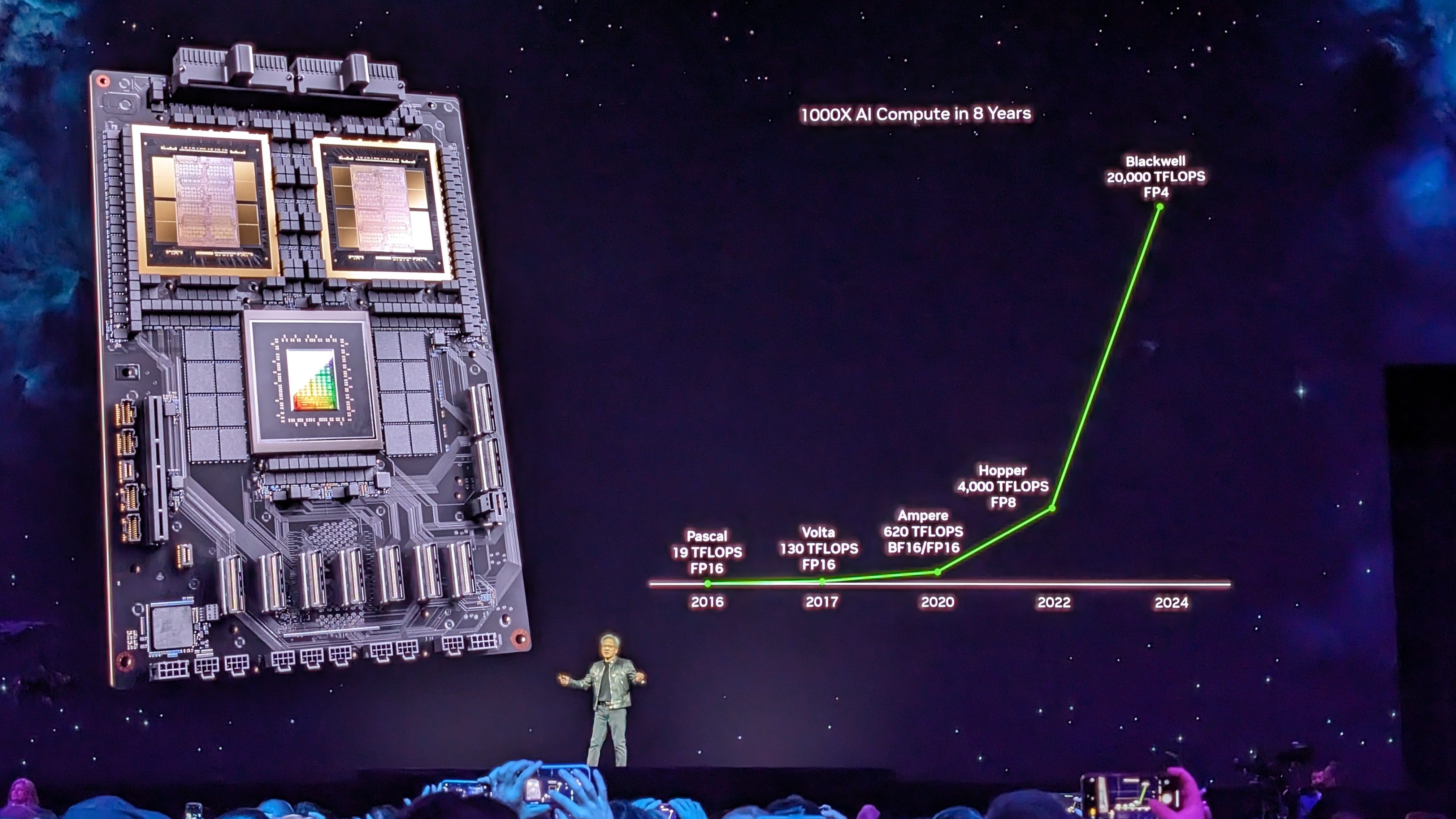

La próxima generación de IA estará impulsada por NVIDIA hardware, declaró la compañía después de revelar su próxima generación de GPU.

El director ejecutivo de la empresa, Jensen Huang, presentó los nuevos chips Blackwell en Nvidia GTC 2024 hoy, prometiendo un gran paso adelante en términos de potencia y eficiencia de la IA.

El primer «superchip» de Blackwell, el GB200, se lanzará a finales de este año, con la capacidad de ampliarse desde un solo bastidor hasta un centro de datos completo, mientras Nvidia busca seguir adelante con su liderazgo en la carrera de la IA. .

NvidiaBlackwell

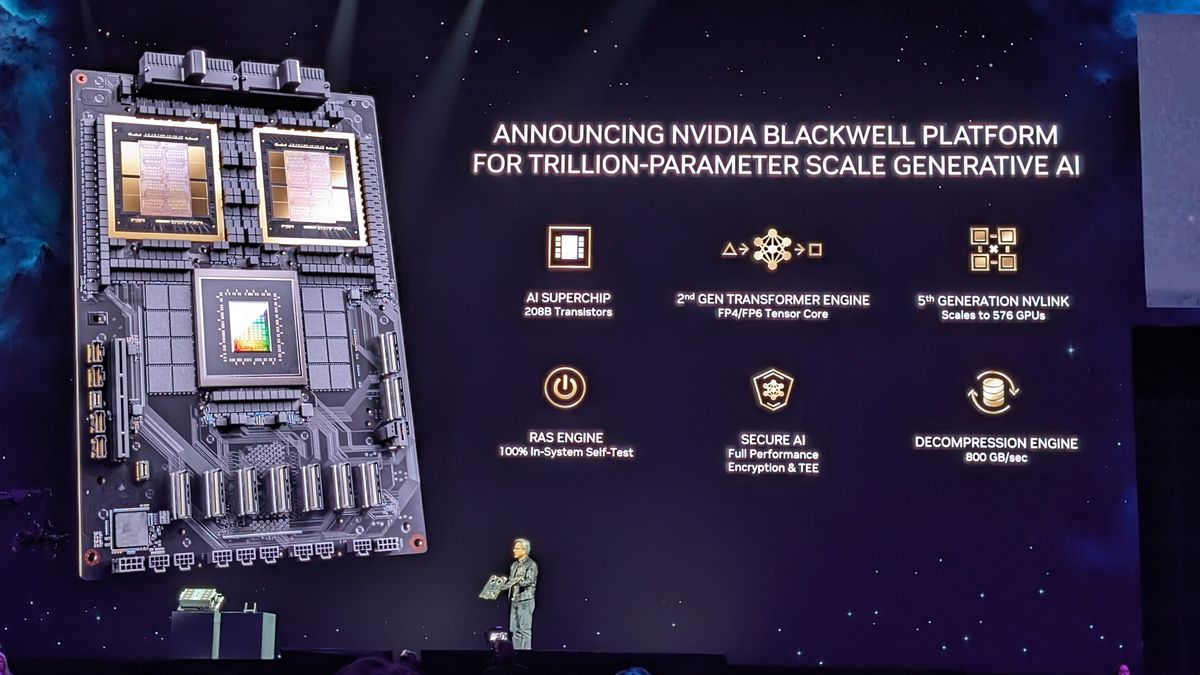

Huang señaló que Blackwell contiene 208 mil millones de transistores (frente a los 80 mil millones en Hopper) en sus dos matrices de GPU, que están conectadas por 10 TB/segundo de chip a chip, lo que representa un importante paso adelante para el hardware de la compañía con respecto a su predecesor, Hopper. enlace en una única GPU unificada.

Esto hace que Blackwell sea hasta 30 veces más rápido que Hopper cuando se trata de tareas de inferencia de IA, ofreciendo hasta 20 petaflops de potencia FP4, muy por delante de cualquier otra cosa en el mercado actual.

Durante su discurso de apertura, Huang destacó no sólo el enorme salto de poder entre Blackwell y Hopper, sino también la gran diferencia de tamaño.

«Blackwell no es un chip, es el nombre de una plataforma», dijo Huang. «Hopper es fantástico, pero necesitamos GPU más grandes».

A pesar de esto, Nvidia dice que Blackwell puede reducir los costos y el consumo de energía hasta 25 veces, dando el ejemplo del entrenamiento de un modelo de 1,8 billones de parámetros, que anteriormente habría requerido 8.000 GPU Hopper y 15 megavatios de potencia, pero que ahora se puede hacer con solo 2.000 Las GPU Blackwell consumen sólo cuatro megavatios.

El nuevo GB200 reúne dos GPU Nvidia B200 Tensor Core y una CPU Grace para crear lo que la compañía simplemente llama «un superchip masivo» capaz de impulsar el desarrollo de la IA, proporcionando 7 veces el rendimiento y cuatro veces la velocidad de entrenamiento de un H10O. sistema.

La compañía también reveló un chip conmutador de red NVLink de próxima generación con 50 mil millones de transistores, lo que significará que 576 GPU podrán comunicarse entre sí, creando 1,8 terabytes por segundo de ancho de banda bidireccional.

Nvidia ya ha contratado a una serie de socios importantes para construir sistemas impulsados por Blackwell, con AWS, Google Nube, microsoft Azure y Oracle Cloud Infrastructure ya están incorporados junto con una gran cantidad de grandes nombres de la industria.