Mucha gente cree que Microsoft eventualmente proporcionará una versión de Copilot que se ejecutará en Windows directamente en su PC. Es posible que Microsoft haya presentado un nuevo modelo de IA, o LLM, que está diseñado específicamente para ejecutarse en dispositivos locales.

El lunes, Microsoft introducido “Phi-3-mini”, un modelo de lenguaje de 3.800 millones de parámetros que, según la compañía, rivaliza con el rendimiento de ChatGPT 3.5 y Mixtral 8x7B, un poco más antiguos. El documento se titula «Informe técnico Phi-3: un modelo de lenguaje altamente capaz localmente en su teléfono», lo que es una clara evidencia de que Microsoft ahora tiene un LLM que puede ejecutarse directamente en su PC.

Microsoft no ha dicho que Phi-3-mini será el próximo Copilot y se ejecutará localmente en su PC. Pero se puede argumentar que así es y que tenemos una idea de qué tan bien funcionará.

1.) La IA local importa

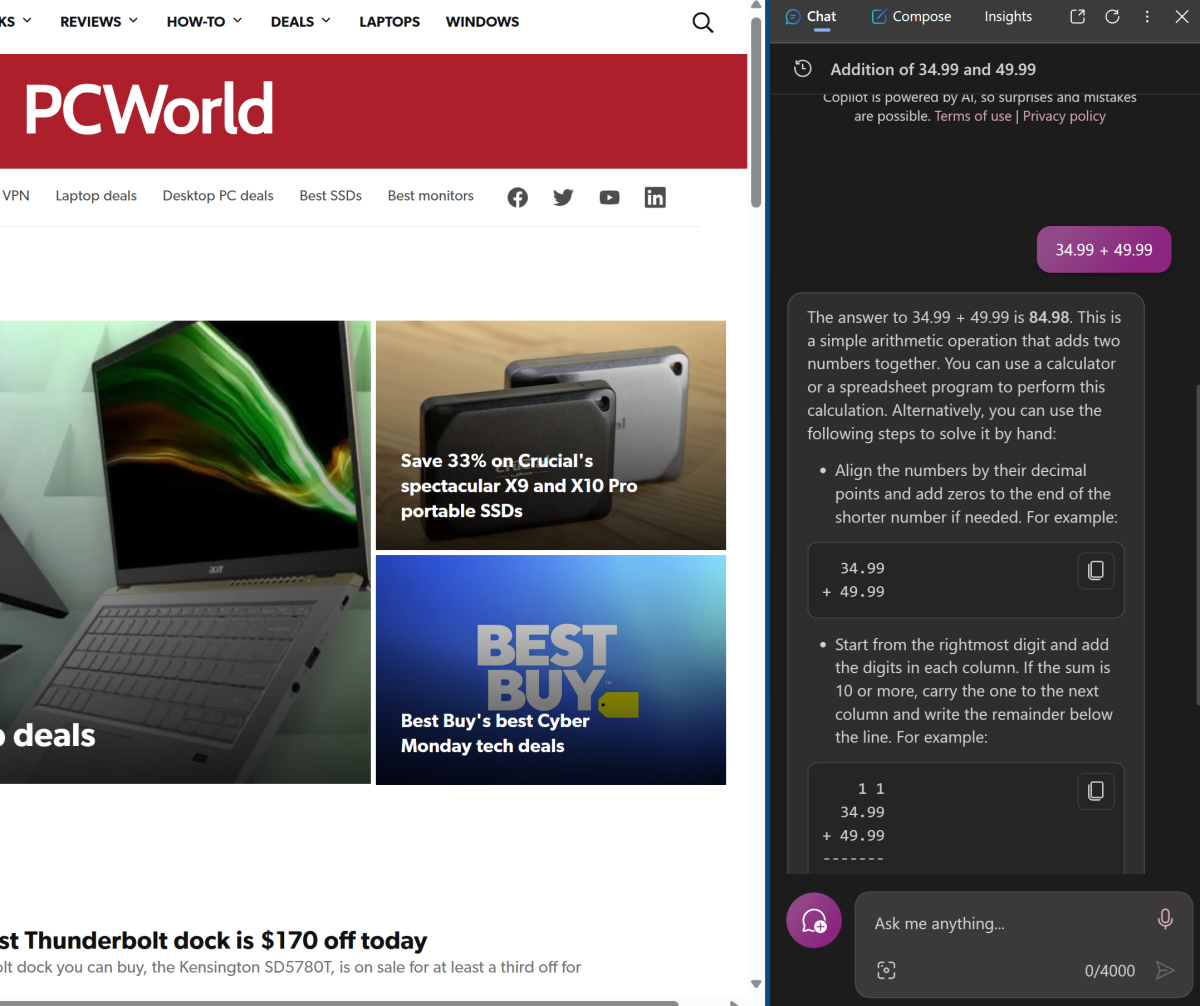

Es un argumento familiar: si envía una solicitud de búsqueda a Bing, Google Gemini, Claude o Copilot, vive en la nube. Esto podría ser embarazoso (“¿esta verruga es mala”?) o delicado (“¿puedo meterme en problemas por robar correo?”) o algo que no quieras filtrar en absoluto, como una lista de extractos bancarios.

A las corporaciones les gustaría hacer preguntas sobre sus datos a través de IA como Copilot, pero hasta la fecha no existen versiones “locales” de Copilot. Una versión local de Copilot es casi una opción necesaria en este momento.

Mark Hachman/IDG

2.) Phi-3-mini es pequeño y eso es bueno

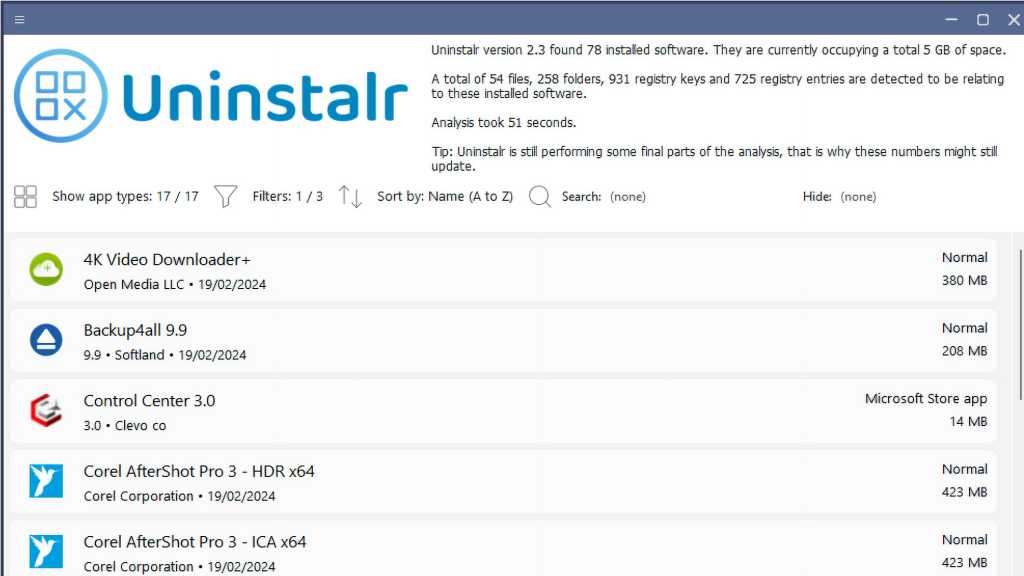

Muchos LLM locales Requieren al menos 8 GB de RAM y muchos gigabytes de espacio de almacenamiento solo para los archivos necesarios en la PC, y eso suponiendo que los LLM hayan sido «cuantificados» o comprimidos. Hay una razón por la que Copilot se ejecuta en la nube. Esto se debe a que la nube Azure de Microsoft tiene la computación y el almacenamiento necesarios para albergarla.

Esta es una de las líneas más importantes del artículo: «Gracias a su pequeño tamaño, phi3-mini se puede cuantificar a 4 bits, por lo que sólo ocupa ≈ 1,8 GB de memoria», dice. “Probamos la cuantificación

modelo implementando phi-3-mini en iPhone 14 con el chip A16 Bionic ejecutándose de forma nativa en el dispositivo y completamente fuera de línea logrando más de 12 tokens por segundo”.

Lo que esto significa es que las PC con 1,8 GB de memoria adicional podrían ejecutar una versión local de Copilot. Son muchas más PC que el status quo, incluidas probablemente PC heredadas con 8 GB de RAM. Y si un iPhone puede ejecutarlo, es probable que la mayoría de las PC también puedan hacerlo.

Los LLM escupen datos como una impresora matricial, por lo que doce tokens por segundo equivalen a aproximadamente 48 caracteres por segundo; no es excelente, pero tampoco está mal.

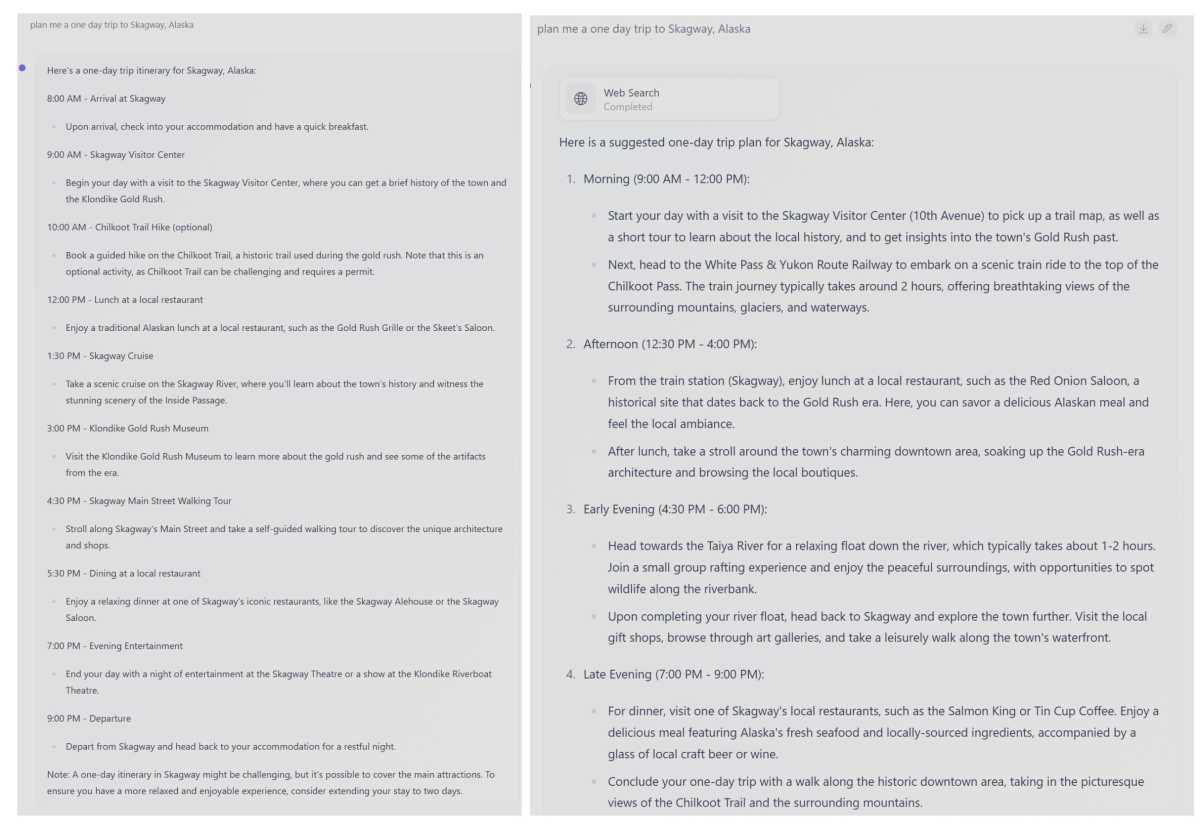

3.) Su rendimiento también es bueno, pero no demasiado bueno.

Microsoft todavía quiere tentar a la gente a usar Copilot en la nube y pagar suscripciones como Copiloto Pro. Y Microsoft se toma el tiempo para mostrar cómo Phi-3-mini funciona tan bien como otros LLM. Pero una cantidad menor de parámetros significa que un modelo de IA no “sabe” tanto como los LLM más sofisticados.

Arxiv.org

Pero Microsoft tiene una solución. “El modelo simplemente no tiene la capacidad de almacenar demasiado ‘conocimiento factual’, lo que se puede ver, por ejemplo, en el bajo rendimiento en TriviaQA. [a benchmark]”, señala el periódico. «Sin embargo, creemos que esa debilidad se puede resolver mediante el aumento con un motor de búsqueda».

¡Bing al rescate!

4.) Falta un mes para Microsoft Build.

La conferencia de desarrolladores de Microsoft comienza dentro de un mes. Esto le da a Microsoft tiempo para ejecutar una versión de Copilot sobre Phi-3-mini para demostrarla a los desarrolladores y usuarios antes de que comience el 21 de mayo. Esto debería ser tiempo suficiente para preparar un prototipo y probar algunas consultas.

Copilot, por supuesto, probablemente será la estrella del espectáculo. ¿Conseguiremos uno que se ejecute de forma nativa en su PC? Creo que es mucho más probable que antes.