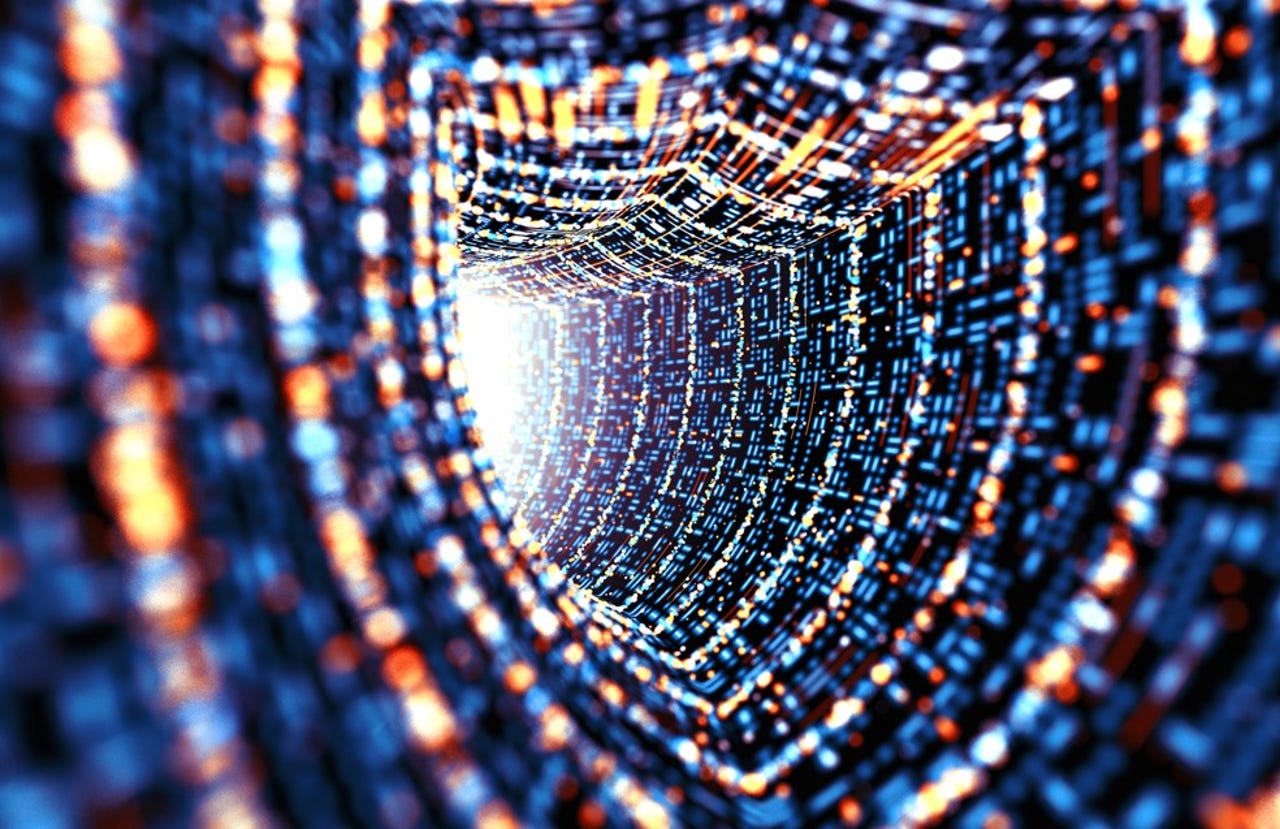

La IA y la ciberseguridad han sido inextricablemente vinculado durante muchos años. Los buenos usan la IA para analizar los paquetes de datos entrantes y ayudar a bloquear actividades maliciosas, mientras que los malos usan la IA para encontrar y crear brechas en la seguridad de sus objetivos. La IA ha contribuido a la creciente carrera de armamentos.

La IA se ha utilizado para fortalecer los sistemas de defensa analizando grandes cantidades de tráfico entrante a la velocidad de una máquina e identificando patrones conocidos y emergentes. A medida que los delincuentes, los piratas informáticos y los Estados-nación implementan ataques cada vez más sofisticados, se utilizan herramientas de inteligencia artificial para bloquear algunos de esos ataques y ayudar a los defensores humanos intensificando solo los comportamientos de ataque más críticos o complejos.

También: Cómo la IA puede mejorar la ciberseguridad aprovechando la diversidad

Pero los atacantes también tienen acceso a los sistemas de inteligencia artificial y se han vuelto más sofisticados tanto en la búsqueda de exploits como en el uso de tecnologías como la inteligencia artificial para multiplicar por la fuerza su grupo de autores intelectuales criminales. Eso suena hiperbólico, pero a los malos parece que no les faltan programadores muy talentosos que, motivados por el dinero, el miedo o la ideología para causar daño, están usando sus talentos para atacar la infraestructura.

Nada de esto es nuevo y ha sido un desafío continuo durante años. Esto es lo que es Nuevo: hay una nueva clase de objetivos: el sistema de inteligencia artificial de valor empresarial (principalmente los llamamos chatbots). En este artículo, brindaré algunos antecedentes sobre cómo, mediante el uso de firewalls, hemos protegido el valor empresarial en el pasado, y cómo se está desarrollando y probando una nueva generación de firewall para proteger los desafíos exclusivos de operar y confiar. sobre chatbots de IA en el ámbito comercial.

Comprender los cortafuegos

Los tipos de ataques y defensas practicados por la ciberseguridad tradicional (sí, ha pasado suficiente tiempo como para que podamos llamarla «tradicional») basada en IA ocurren en las capas de red y transporte de la pila de red. El modelo OSI es un marco conceptual desarrollado por la Organización Internacional de Normalización para comprender y comunicar las diversas capas operativas de una red moderna.

La capa de red enruta paquetes a través de redes, mientras que la capa de transporte gestiona la transmisión de datos, garantizando la confiabilidad y el control del flujo entre los sistemas finales.

También: ¿Quieres trabajar en IA? Cómo dar un giro a tu carrera en 5 pasos

Ocurriendo en las capas 3 y 4 respectivamente de la modelo de red OSI, los ataques tradicionales han estado bastante cerca del hardware y el cableado de la red y bastante lejos de la capa 7, la capa de aplicación. Es en la capa de aplicaciones donde la mayoría de las aplicaciones en las que los humanos confiamos a diario pueden hacer lo suyo. Aquí hay otra forma de pensar en esto: la infraestructura de red se encuentra en las capas inferiores, pero el valor comercial se encuentra en la capa 7.

Las capas de red y transporte son como la cadena subterránea de cavernas y pasillos interconectados que conectan los edificios de una ciudad y sirven como conductos para las entregas y la eliminación de residuos, entre otras cosas. La capa de aplicación es como esos bonitos escaparates donde los clientes hacen sus compras.

En el mundo digital, los firewalls de red han estado durante mucho tiempo en primera línea, defendiendo contra ataques de capa 3 y 4. Pueden escanear datos a medida que llegan, determinar si hay una carga útil oculta en un paquete y bloquear la actividad de ubicaciones consideradas particularmente preocupantes.

Pero hay otro tipo de firewall que existe desde hace algún tiempo: el firewall de aplicaciones web o WAF. Su trabajo es bloquear la actividad que ocurre a nivel de la aplicación web.

Un WAF monitorea, filtra y bloquea el tráfico HTTP malicioso; previene ataques de inyección SQL y scripts entre sitios (XSS), fallas de inyección, autenticación rota y exposición de datos confidenciales; proporciona conjuntos de reglas personalizadas para protecciones específicas de aplicaciones; y mitiga los ataques DDoS, entre otras protecciones. En otras palabras, evita que las personas malas hagan cosas malas en páginas web buenas.

Ahora estamos empezando a ver cortafuegos de IA que protegen los datos de nivel 7 (el valor empresarial) en el nivel del chatbot de IA. Antes de que podamos discutir cómo los firewalls podrían proteger esos datos, es útil comprender cómo se pueden atacar los chatbots de IA.

Cuando la gente mala ataca a los buenos chatbots de IA

En el último año, hemos visto el surgimiento de la IA generativa, práctica y funcional. Esta nueva variante de IA no sólo vive en ChatGPT. Las empresas lo están implementando en todas partes, pero especialmente en las interfaces de atención al cliente, soporte al usuario, asistencia de ventas autónoma e incluso en diagnósticos médicos.

Hay cuatro enfoques para atacar a los chatbots de IA. Debido a que estas soluciones de IA son tan nuevas, estos enfoques siguen siendo en su mayoría teóricos, pero se espera que los piratas informáticos de la vida real sigan estos caminos en el próximo año aproximadamente.

Ataques adversarios: El periódico ScienceNews analiza cómo los exploits pueden atacar la forma en que funcionan los modelos de IA. Los investigadores están construyendo frases o indicaciones que parecen válidas para un modelo de IA pero que están diseñadas para manipular sus respuestas o provocar algún tipo de error. El objetivo es hacer que el modelo de IA revele potencialmente información confidencial, rompa protocolos de seguridad o responda de una manera que pueda usarse para avergonzar a su operador.

Hablé de una variación muy simplista de este tipo de ataque cuando un usuario introdujo mensajes engañosos en la interfaz desprotegida del chatbot de Chevrolet de Watsonville. las cosas no salieron bien.

Inyección inmediata indirecta: Cada vez más chatbots leerán páginas web activas como parte de sus conversaciones con los usuarios. Esas páginas web pueden contener cualquier cosa. Normalmente, cuando un sistema de inteligencia artificial extrae el contenido de un sitio web, es lo suficientemente inteligente como para distinguir entre texto legible por humanos que contiene conocimiento para procesar y código de soporte y directivas para formatear la página web.

También: No estamos preparados para el impacto de la IA generativa en las elecciones

Pero los atacantes pueden intentar insertar instrucciones y formatos en aquellas páginas web que engañan lo que los está leyendo, lo que podría manipular un modelo de IA para que divulgue información personal o confidencial. Este es un peligro potencialmente enorme, porque los modelos de IA dependen en gran medida de datos obtenidos de la amplia y salvaje Internet. Los investigadores del MIT han explorado este problema y han concluido que «los chatbots de IA son un desastre de seguridad».

Intoxicación de datos: Aquí es donde (estoy bastante convencido) los desarrolladores de grandes modelos de lenguaje (LLM, por sus siglas en inglés) están haciendo todo lo posible para dispararse en sus pies virtuales. El envenenamiento de datos es la práctica de insertar datos de entrenamiento incorrectos en modelos de lenguaje durante el desarrollo, esencialmente el equivalente a tomar una clase de geografía sobre la naturaleza esférica del planeta desde el principio. Sociedad de la Tierra Plana. La idea es introducir datos espurios, erróneos o intencionalmente engañosos durante la formación del LLM para que luego arroje información incorrecta.

Mi ejemplo favorito de esto es cuando Google obtuvo la licencia del contenido de Stack Overflow para su Gemini LLM. Stack Overflow es uno de los foros de soporte para desarrolladores en línea más grandes con la participación de más de 100 millones de desarrolladores. Pero como sabe cualquier desarrollador que haya utilizado el sitio durante más de cinco minutos, por cada respuesta lúcida y útil, hay de cinco a 10 respuestas ridículas y probablemente 20 respuestas más que argumentan la validez de todas las respuestas.

También: Los mejores servicios VPN de 2024: probados por expertos

Entrenar a Gemini usando esos datos significa que Gemini no sólo tendrá un tesoro de respuestas únicas y valiosas para todo tipo de problemas de programación, sino que también tendrá una enorme colección de respuestas que resultan en resultados terribles.

Ahora, imagínese si los piratas informáticos supieran que los datos de Stack Overflow se utilizarán regularmente para entrenar a Gemini (y lo saben porque ha sido cubierto por ZDNET y otros medios tecnológicos): pueden elaborar preguntas y respuestas diseñadas deliberadamente para engañar a Gemini y sus usuarios.

Denegación de servicio distribuida: Si no creía que se pudiera usar un DDoS contra un chatbot de IA, piénselo de nuevo. Cada consulta de IA requiere una enorme cantidad de datos y recursos informáticos. Si un pirata informático inunda un chatbot con consultas, podría ralentizar o congelar sus respuestas.

Además, muchos chatbots verticales obtienen licencias de API de IA de proveedores como ChatGPT. Una alta tasa de consultas espurias podría aumentar el costo para esos licenciatarios si pagan mediante acceso medido. Si un pirata informático aumenta artificialmente la cantidad de llamadas API utilizadas, el titular de la licencia de API puede exceder su cuota de licencia o enfrentar cargos sustancialmente mayores por parte del proveedor de IA.

Defensa contra ataques de IA

Dado que los chatbots se están convirtiendo en componentes críticos de la infraestructura de valor empresarial, su funcionamiento continuo es esencial. También debe protegerse la integridad del valor empresarial proporcionado. Esto ha dado lugar a una nueva forma de firewall, uno diseñado específicamente para proteger la infraestructura de IA.

También: ¿Cómo funciona realmente ChatGPT?

Recién estamos comenzando a ver firewalls de IA generativos como el Firewall para servicio de IA anunciado por la empresa de seguridad de redes perimetrales Cloudflare. El firewall de Cloudflare se encuentra entre la interfaz del chatbot en la aplicación y el propio LLM, interceptando las llamadas API de la aplicación antes de que lleguen al LLM (el cerebro de la implementación de la IA). El firewall también intercepta las respuestas a las llamadas API y las valida contra actividades maliciosas.

Entre las protecciones que ofrece esta nueva forma de firewall se encuentra la detección de datos confidenciales (SDD). SDD no es nuevo en los firewalls de aplicaciones web, pero el potencial de que un chatbot muestre datos confidenciales no deseados es considerable, por lo que hacer cumplir las reglas de protección de datos entre el modelo de IA y la aplicación empresarial agrega una capa importante de seguridad.

Además, esto evita que las personas que utilizan el chatbot (por ejemplo, los empleados internos de una empresa) compartan información empresarial confidencial con un modelo de IA proporcionado por una empresa externa como OpenAI. Este modo de seguridad ayuda a evitar que la información entre en la base de conocimiento general del modelo público.

El firewall de inteligencia artificial de Cloudflare, una vez implementado, también está destinado a gestionar los abusos del modelo, una forma de inyección rápida y ataque adversario destinado a corromper el resultado del modelo. Cloudflare menciona específicamente este caso de uso:

Un caso de uso común que escuchamos de los clientes de nuestro AI Gateway es que quieren evitar que su aplicación genere lenguaje tóxico, ofensivo o problemático. Los riesgos de no controlar el resultado del modelo incluyen daños a la reputación y daños al usuario final al proporcionar una respuesta poco confiable.

Hay otras formas en que un firewall de aplicaciones web puede mitigar los ataques, particularmente cuando se trata de un ataque volumétrico como el bombardeo de consultas, que efectivamente se convierte en un DDoS de propósito especial. El firewall emplea funciones de limitación de velocidad que reducen la velocidad y el volumen de las consultas, y filtra aquellas que parecen estar diseñadas específicamente para romper la API.

No está del todo listo para el horario de máxima audiencia

Según Cloudflare, los clientes ahora pueden implementar protecciones contra ataques volumétricos de estilo DDoS y detección de datos confidenciales. Sin embargo, las funciones de validación rápida (básicamente, las funciones del firewall de IA fuertemente centradas en la IA) aún están en desarrollo y entrarán en versión beta en los próximos meses.

También: La IA generativa nos llenó de asombro en 2023, pero toda magia tiene un precio

Normalmente, no me gustaría hablar sobre un producto en esta etapa inicial de desarrollo, pero creo que es importante mostrar cómo la IA ha ingresado al uso de la infraestructura de aplicaciones comerciales convencionales hasta el punto en que es a la vez objeto de ataque y donde se requiere trabajo sustancial. Se está haciendo algo para proporcionar defensas basadas en IA.

Manténganse al tanto. Realizaremos un seguimiento de las implementaciones de IA y de cómo cambian los contornos del mundo de las aplicaciones empresariales. También analizaremos los problemas de seguridad y cómo las empresas pueden mantener seguras esas implementaciones.

Siempre ha sido una carrera armamentista. La IA simplemente trae una nueva clase de armas para desplegar y defender.

Puedes seguir las actualizaciones diarias de mi proyecto en las redes sociales. Asegúrese de suscribirse a mi boletín de actualización semanal en subpilay sígueme en Twitter en @DavidGewirtzen Facebook en Facebook.com/DavidGewirtzen Instagram en Instagram.com/DavidGewirtzy en YouTube en YouTube.com/DavidGewirtzTV.