No hay duda de que la IA generativa (genAI) y los grandes modelos de lenguaje (LLM) son fuerzas disruptivas que seguirán transformando nuestra industria y economía de manera profunda. Pero también hay algo muy familiar en el camino que están tomando las organizaciones para aprovechar las capacidades de la IA de generación.

Es el mismo viaje que ocurre cada vez que se necesitan datos que sirvan para un propósito muy específico y limitado. Lo hemos visto en la búsqueda, donde los motores de búsqueda de texto completo han proliferado, lo que ha dado como resultado dominios de búsqueda específicos y la experiencia requerida para implementar y mantener. También lo hemos visto con datos de series de tiempo, donde la necesidad de ofrecer experiencias en tiempo real mientras se soluciona la conectividad intermitente ha resultado en una proliferación de soluciones específicas de borde para manejar datos con marca de tiempo.

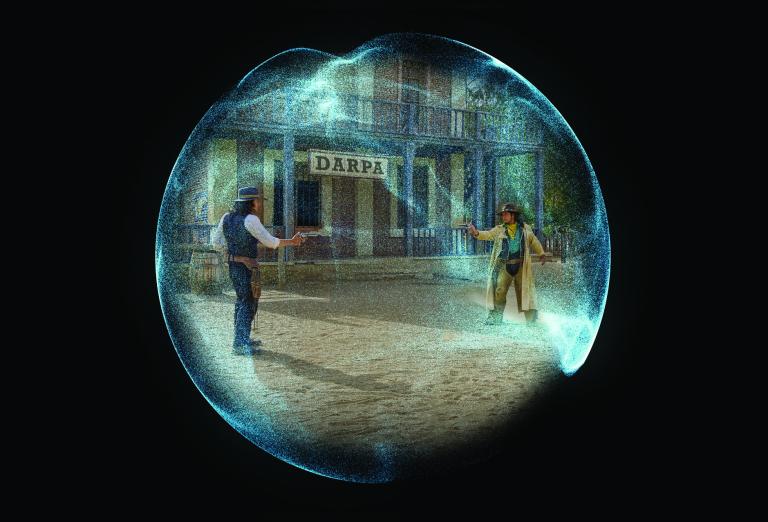

Y ahora lo estamos viendo con la IA de generación y los LLM, donde están surgiendo soluciones de nicho para manejar el volumen y la velocidad de todos los datos nuevos que están creando las organizaciones. El desafío para los tomadores de decisiones de TI es encontrar una manera de capitalizar nuevas formas innovadoras de usar y trabajar con datos y al mismo tiempo minimizar la experiencia adicional, el almacenamiento y los recursos informáticos necesarios para implementar y mantener soluciones diseñadas específicamente.

Costo y complejidad diseñados específicamente

El proceso de incorporación de bases de datos de búsqueda ilustra los efectos posteriores que tiene en los desarrolladores la adición de una base de datos especialmente diseñada. Para aprovechar las funciones de búsqueda avanzada, como la búsqueda difusa y los sinónimos, las organizaciones normalmente incorporarán una solución de búsqueda específica como Solr, Elasticsearch, Algolia y OpenSearch. Una base de datos de búsqueda dedicada es otro sistema más que requiere recursos de TI para su implementación, gestión y mantenimiento. Las soluciones específicas o específicas como estas a menudo requieren veteranos en tecnología que puedan implementarlas y optimizarlas de manera experta. La mayoría de las veces, es responsabilidad de una persona o de un pequeño equipo descubrir cómo levantar, configurar y optimizar el nuevo entorno de búsqueda.

Los datos de series de tiempo son otro ejemplo. El esfuerzo que se necesita para escribir un código de sincronización que resuelva los conflictos entre el dispositivo móvil y el back-end consume una cantidad considerable de tiempo de los desarrolladores. Además de eso, el trabajo no es diferenciador ya que los usuarios esperan ver información actualizada y no perder datos como resultado de un código de resolución de conflictos mal escrito. Por lo tanto, los desarrolladores dedican un tiempo precioso a trabajos que no son estratégicamente importantes para el negocio ni diferencian su producto o servicio de la competencia.

Es probable que la llegada y proliferación de la IA de generación y los LLM aceleren nuevas inversiones en TI para capitalizar esta poderosa tecnología revolucionaria. Muchas de estas inversiones tomarán la forma de recursos tecnológicos dedicados y talento de desarrolladores para su puesta en funcionamiento. Pero lo último que necesitan los compradores y desarrolladores de tecnología es otra solución de nicho que retire recursos de otras iniciativas estratégicamente importantes.

Documentos al rescate

Aprovechar genAI y LLM para obtener nuevos conocimientos, crear nuevas experiencias de usuario e impulsar nuevas fuentes de ingresos puede implicar algo más que una expansión y complejidad arquitectónica adicional. Basándose en el modelo de datos de documentos flexible, los desarrolladores pueden almacenar incrustaciones de vectores (representaciones numéricas de datos que impulsan las soluciones de IA) junto con datos operativos, lo que les permite moverse rápidamente y aprovechar los rápidos avances en la generación de IA sin tener que aprender nuevas herramientas. o servicios propietarios.

Los documentos son el vehículo perfecto para el desarrollo de funciones genAI porque proporcionan un mapeo intuitivo y fácil de entender de datos en objetos de código. Además, la flexibilidad que brindan permite a los desarrolladores adaptarse a los requisitos de las aplicaciones en constante cambio, ya sea la adición de nuevos tipos de datos o la implementación de nuevas funciones. La enorme diversidad de datos de su aplicación típica e incluso incrustaciones de vectores de miles de dimensiones se pueden manejar con documentos.

Aprovechar un enfoque de plataforma unificada, donde la búsqueda de texto, la búsqueda vectorial, el procesamiento de secuencias y las operaciones CRUD están completamente integradas y son accesibles a través de una única API, elimina la molestia del cambio de contexto entre diferentes lenguajes de consulta y controladores, al mismo tiempo que mantiene su pila tecnológica ágil y optimizada. .

Aprovechar al máximo la genAI

La innovación impulsada por la IA está superando lo que es posible en términos de la experiencia del usuario, pero para encontrar un valor empresarial transformador real, debe integrarse perfectamente como parte de una aplicación integral y rica en funciones que mueva la aguja para las empresas de manera significativa. maneras.

MongoDB Atlas elimina la complejidad de los proyectos impulsados por IA. La plataforma de datos para desarrolladores Atlas agiliza el proceso de llevar al mercado nuevas experiencias impulsadas por IA de forma rápida y rentable.

Para obtener más información sobre cómo Atlas ayuda a las organizaciones a integrar y poner en funcionamiento datos genAI y LLM, descargue nuestro documento técnico. Incorporación de IA generativa y búsqueda avanzada en sus aplicaciones con MongoDB.

Copyright © 2024 IDG Communications, Inc.