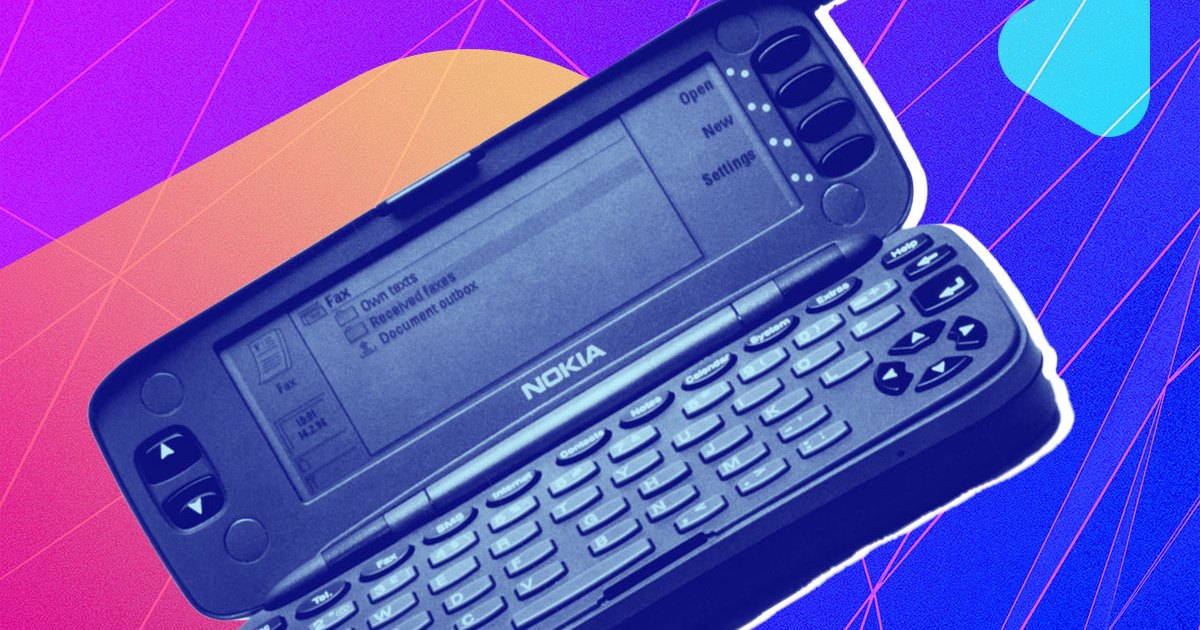

ChatGPT y GPT-4 obtuvieron puntuaciones superiores a la mayoría de los estudiantes en los grados 4, 8 y 12 en una prueba estandarizada de preguntas de ciencias. Skynesher/Getty Images

El Boletín de Calificaciones de la Nación, también conocido como Evaluación Nacional del Progreso Educativo, NAEP, es una prueba estandarizada de capacidad del estudiante en los EE. UU. que ha sido administrado desde 1969 por la Junta de Educación de los EE. UU. La prueba es ampliamente citada como el punto de referencia de la situación de los estudiantes en su capacidad para leer, escribir, hacer matemáticas, comprender experimentos científicos y muchas otras áreas de competencia.

El año pasado, la prueba tuvo un mensaje desalentador para profesores, administradores y padres: las puntuaciones de matemáticas de los adolescentes mostraron la mayor caída jamás registrada desde el inicio de la evaluación, en medio de una tendencia general a largo plazo de disminución de las puntuaciones en matemáticas y lectura.

El declive se produce al mismo tiempo que el aumento de inteligencia artificial generativa (IA), como ChatGPT de OpenAIY, obviamente, mucha gente se pregunta si existe una conexión.

«ChatGPT y GPT-4 superaron consistentemente a la mayoría de los estudiantes que respondieron cada ítem individual en las evaluaciones de ciencias de la NAEP», escriben Xiaoming Zhai de la Universidad de Georgia y colegas del Centro Educativo AI4STEM de la Universidad y de la Facultad de Ciencias de la Salud de la Universidad de Alabama. Educación, en un periódico publicado esta semana en el servidor de preimpresión arXiv«¿Pueden la IA generativa y Chatgpt superar a los humanos en tareas científicas de resolución de problemas cognitivamente exigentes?»

También: IA en 2023: un año de avances que no dejaron ninguna cosa humana sin cambios

El informe es «el primer estudio que se centra en comparar estudiantes de vanguardia de GAI y K-12 en la resolución de problemas en ciencias», afirman Zhai y su equipo.

El año pasado se realizaron numerosos estudios que muestran que ChatGPT puede «igualar el desempeño humano en la práctica y transferir problemas, alineándose con los resultados más probables esperados de una muestra humana», lo que, escriben, «subraya la capacidad de ChatGPT para reflejar el éxito promedio». tasa de sujetos humanos, mostrando así su competencia en tareas cognitivas».

Los autores construyeron un examen NAEP para ChatGPT y GPT-4 seleccionando 33 preguntas de opción múltiple sobre resolución de problemas científicos, junto con cuatro preguntas designadas como «respuesta seleccionada», en las que el examinado selecciona una respuesta apropiada de una lista después de leer un pasaje. Hay tres preguntas que presentan un escenario, con secuencias de preguntas conectadas; y 11 preguntas de «respuesta construida» y 3 preguntas de «respuesta construida extendida», donde el examinado tiene que escribir una respuesta en lugar de elegir entre las respuestas ofrecidas.

Un ejemplo de una pregunta científica podría involucrar un escenario imaginario de una banda elástica estirada entre dos clavos, pidiéndole al estudiante que articule por qué causa un sonido cuando se tira y qué haría que el sonido alcanzara un tono más alto. Esa pregunta requiere que el estudiante escriba una respuesta sobre las vibraciones del aire de la banda elástica y cómo el aumento de la tensión podría aumentar el tono de la vibración.

Ejemplo de una pregunta de respuesta construida que pone a prueba el razonamiento científico. Universidad de Georgia

Todas las preguntas estaban orientadas a los grados 4, 8 y 12. El resultado de ChatGPT y GPT-4 se comparó con las respuestas anónimas de los examinados humanos, en promedio, proporcionadas a los autores por el Departamento de Educación.

ChatGPT y GPT-4 respondieron las preguntas con una precisión «por encima de la media» y, de hecho, los estudiantes humanos obtuvieron puntuaciones abismalmente en comparación con los dos programas en numerosas pruebas. ChatGPT obtuvo mejores calificaciones que el 83%, 70% y 81% de los estudiantes en las preguntas de 4.º, 8.º y 12.º grado, y GPT-4 obtuvo resultados similares, por delante del 74%, 71% y 81%, respectivamente.

Los autores tienen una teoría de lo que está sucediendo y sugiere en términos claros el tipo de rutina que crean las pruebas estandarizadas. Los estudiantes humanos terminan siendo algo así como la famosa historia de John Henry tratando de competir contra el perforador de roca impulsado por vapor.

Los autores se basan en un marco en psicología conocido como «carga cognitiva«, que mide la intensidad con la que una tarea desafía la memoria de trabajo del cerebro humano, el lugar donde se guardan los recursos durante un período breve. Al igual que la DRAM de la computadora, la memoria a corto plazo tiene una capacidad limitada y las cosas se eliminan en momentos de corta duración. memoria a largo plazo, ya que hay que prestar atención a nuevos hechos.

También: Verifiqué ChatGPT con Bard, Claude y Copilot, y se volvió extraño

«La carga cognitiva en la enseñanza de las ciencias analiza el esfuerzo mental que requieren los estudiantes para procesar y comprender conocimientos y conceptos científicos», relatan los autores. Específicamente, la memoria de trabajo puede verse afectada por las diversas facetas de una prueba, que «todas compiten por estos recursos limitados de la memoria de trabajo», como tratar de tener en cuenta todas las variables de una pregunta de la prueba al mismo tiempo.

Las máquinas tienen una mayor capacidad para mantener variables en DRAM, y ChatGPT y GPT-4 pueden, a través de sus diversos pesos neuronales y el contexto explícito escrito en el mensaje, almacenar mucha más información, enfatizan los autores.

La cuestión llega a un punto crítico cuando los autores analizan la capacidad de cada estudiante en correlación con la complejidad de la pregunta. El estudiante promedio se estanca a medida que las preguntas se vuelven más difíciles, pero ChatGPT y GPT-4 no.

«Para cada uno de los tres niveles de grado, se requieren puntajes promedio más altos de capacidad de los estudiantes en las evaluaciones de ciencias de la NAEP con mayor demanda cognitiva; sin embargo, el desempeño tanto de ChatGPT como de GPT-4 podría no afectar significativamente las mismas condiciones, excepto para el grado 4 más bajo. «.

También: Cómo utilizar Bing Image Creator (y por qué es mejor que nunca)

En otras palabras: «Su falta de sensibilidad a la demanda cognitiva demuestra el potencial de GAI para superar la memoria de trabajo que sufren los humanos cuando utilizan el pensamiento de orden superior que requieren los problemas».

Los autores sostienen que la capacidad de la IA generativa para superar el límite de la memoria de trabajo de los humanos tiene «implicaciones significativas para la evolución de las prácticas de evaluación dentro de los paradigmas educativos» y que «es imperativo que los educadores revisen las prácticas de evaluación tradicionales».

La IA generativa es «omnipresente» en la vida de los estudiantes, señalan, por lo que los estudiantes humanos utilizarán las herramientas, y también serán superados por las herramientas, en pruebas estandarizadas como NAEP.

«Dada la notable insensibilidad del GAI a la carga cognitiva y su papel potencial como herramienta en los futuros esfuerzos profesionales de los estudiantes, resulta crucial recalibrar las evaluaciones educativas», escriben Zhai y su equipo.

El rendimiento promedio de los estudiantes humanos en las preguntas estuvo por debajo de GPT-4 y ChatGPT en la mayoría de las preguntas de los estudiantes de duodécimo grado. Universidad de Georgia

«El enfoque de estas evaluaciones debería pasar de medir únicamente la intensidad cognitiva a un mayor énfasis en la creatividad y la aplicación del conocimiento en contextos novedosos», aconsejan.

«Este cambio reconoce la creciente importancia del pensamiento innovador y las habilidades de resolución de problemas en un panorama cada vez más influenciado por tecnologías avanzadas de GAI».

También: Estos son los puestos de trabajo con mayor probabilidad de que la IA se haga cargo

Los docentes, señalan, «actualmente no están preparados» para lo que parece ser un «cambio significativo» en la pedagogía. Esa transformación significa que corresponde a las instituciones educativas centrarse en el desarrollo profesional de los docentes.

Una nota a pie de página interesante del estudio son las limitaciones de los dos programas. En ciertos casos, un programa u otro solicitó información adicional para una pregunta científica. Cuando uno de los programas preguntó, pero el otro no, «el modelo que no solicitó información adicional a menudo produjo respuestas insatisfactorias». Eso significa, concluyen los autores, que «estos modelos dependen en gran medida de la información proporcionada para generar respuestas precisas».

Las máquinas dependen de lo que esté en el mensaje o en los parámetros aprendidos del modelo. Esa brecha abre un camino para que los humanos, tal vez, sobresalgan cuando ninguna de las fuentes contiene los conocimientos necesarios para las actividades de resolución de problemas.