SK Hynix, una clave Samsung competidor, dice que ha agotado toda su producción de 2024 de memorias DRAM apiladas de alto ancho de banda. Estos chips son cruciales para los procesadores de IA en los centros de datos, pero la empresa mantiene la boca cerrada sobre sus clientes más importantes.

El recientemente nombrado vicepresidente de SK Hynix, Kitae Kim, que también es director de ventas y marketing de HBM, confirmó la noticia en una entrevista publicada en Sitio web de SK Hynix.

«Asegurar proactivamente los volúmenes de compra de los clientes y negociar condiciones más favorables para nuestros productos de alta calidad son los fundamentos de las operaciones de venta de semiconductores», afirmó Kim. “Cuando tenemos excelentes productos entre manos, es una cuestión de velocidad. Nuestro volumen de producción previsto de HBM para este año ya se ha agotado. Aunque 2024 apenas comienza, ya hemos comenzado a prepararnos para 2025 para mantenernos por delante del mercado”.

‘Muy buscado’

Como EE Noticias Europa Como señala, la escasez de chips de formato HBM3 y HBM3E podría potencialmente obstaculizar el crecimiento de los sectores de memoria y lógica de la industria de semiconductores este año.

“HBM es un producto revolucionario que ha desafiado la noción de que la memoria semiconductora es sólo una parte de un sistema global. En particular, HBM de SK Hynix tiene una competitividad excepcional», añadió Kim.

«Nuestra tecnología avanzada es muy buscada por las empresas tecnológicas globales», añadió, dejándonos preguntándonos quiénes podrían ser los mayores clientes de su empresa. NVIDIA y AMD Se sabe que son voraces por los chips de memoria de alto ancho de banda, pero hay otros actores en el altamente competitivo mercado de la IA que podrían estar interesados en hacerse con acciones de HBM para evitar quedarse en la estacada.

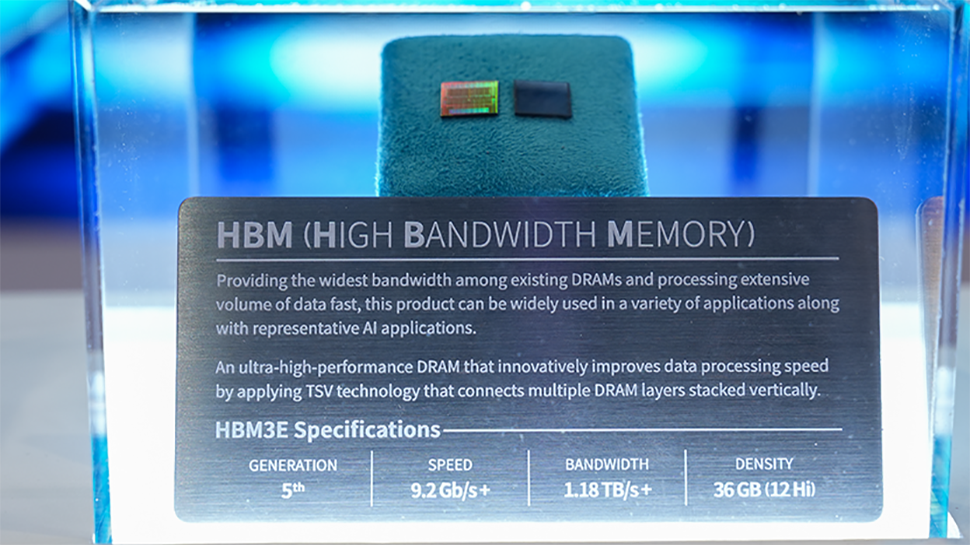

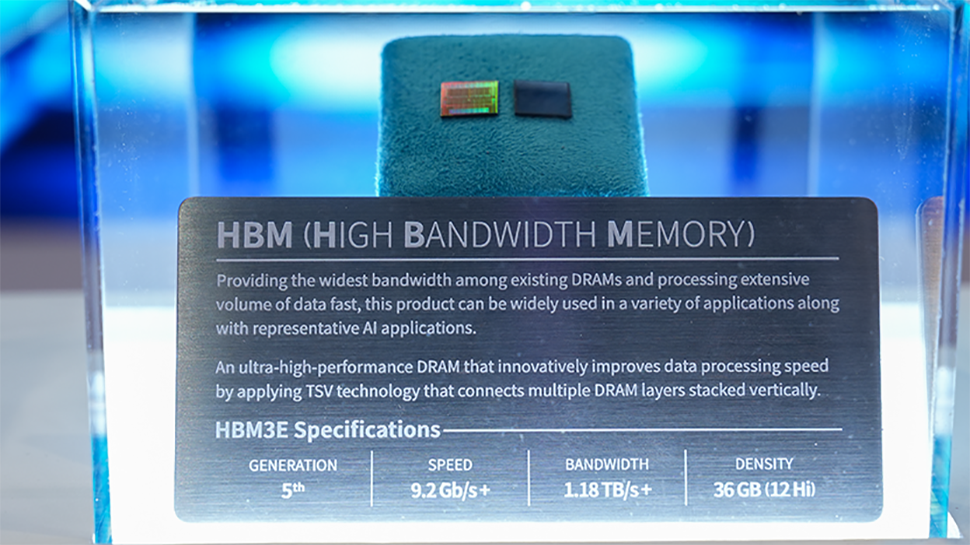

Curiosamente, si bien SK Hynix no puede fabricar suficientes productos HBM actuales para satisfacer la gran demanda, sus principales rivales en este espacio, Samsung y Micron, ahora se centran en HBM3E. Micron ha comenzado a fabricar «en volumen» su HBM3E 8H de 24 GB, que se utilizará en las últimas GPU H200 Tensor Core de Nvidia. Al mismo tiempo, Samsung ha comenzado a probar su HBM3E 12H de 36 GB para los clientes, y esta bien podría ser la memoria utilizada en la B100 de Nvidia. B100 Blackwell potencia de IA que se espera llegue a finales de este año.

Sin embargo, SK Hynix no se quedará atrás por mucho tiempo. Se espera que comience a fabricar su propio HBM3E de 36 GB en el primer semestre de este año, tras una actualización de su planta de Wuxi en China.