Opinión del editor: Para ser claros, no odiamos a Nvidia. Todo lo contrario; Estamos cada vez más convencidos de su fuerte posición en el centro de datos. desde marzo de 2022 Día del Analista: seis meses antes de que ChatGPT encendiera el mundo de la IA. Nuestro título hace referencia a la comedia romántica de 1999, que es una adaptación moderna de Shakespeare. Si bien no diríamos que amamos a Nvidia, tenemos un alto grado de convicción de que seguirán liderando el silicio para centros de datos en el futuro previsible.

Dicho esto, nos esforzamos por lograr la honestidad intelectual, lo que significa que cuanto mayor sea nuestra convicción en una tesis, más necesitamos probarla. Hacer agujeros. Busque formas en las que podríamos estar equivocados. En este caso, queremos explorar todas las formas en que Nvidia podría ser vulnerable.

Nota del editor:

Autor invitado Jonathan Goldberg es el fundador de D2D Advisory, una firma de consultoría multifuncional. Jonathan ha desarrollado estrategias de crecimiento y alianzas para empresas de las industrias de telefonía móvil, redes, juegos y software.

Mirar esto de manera sistémica es un desafío, ya que Nvidia se posiciona como proveedor de soluciones completas, lo que significa que todas las piezas están unidas. Pero dividiremos nuestro análisis en varios grupos y analizaremos cada uno de ellos.

los fabricantes de chips

La primera área es el hardware. Nvidia se ha desempeñado increíblemente bien durante varios años y tiene una clara ventaja en rendimiento. En términos generales, ellos dominar el mercado de la formación en IA. Sin embargo, se espera que el mercado de inferencia en la nube sea más grande y, en este caso, la economía importará más que el rendimiento bruto. Es probable que este cambio introduzca mucha más competencia.

En términos generales, Nvidia domina el mercado de la formación en IA.

El competidor más cercano aquí es AMD con su serie MI300. Si bien este hardware tiene un alto rendimiento, todavía carece de muchas funciones. Probablemente sea lo suficientemente bueno como para hacerse un hueco para AMD, pero parece poco probable que tenga un impacto significativo en la cuota de mercado de Nvidia por el momento. Intel y su recientemente lanzado acelerador Gaudi 3 son suficientes para demostrar que Intel todavía está en el juego, pero el dispositivo no es programable ni tiene todas las funciones, lo que limita la capacidad de Intel para desafiar a Nvidia en ciertos segmentos del mercado. En general, entre las principales empresas de chips, Nvidia parece estar bien posicionada.

Además, hay una serie de nuevas empresas que persiguen este mercado. El más avanzado es probablemente Groq, que ha publicado algunos puntos de referencia de inferencia bastante impresionantes. Sin embargo, nuestra evaluación es que su solución sólo es adecuada para un subconjunto de tareas de inferencia de IA. Si bien esto podría ser suficiente para que Groq siga siendo competitivo, no representa una amenaza para Nvidia en grandes porciones del mercado.

Los hiperescaladores

La competencia más seria proviene de las soluciones de silicio internas de los hiperescaladores.

Google es, con diferencia, el más avanzado en este ámbito. Recientemente revelaron que utilizaron sus TPU para entrenar el modelo de lenguaje grande Gemini, la única grieta importante en el dominio del entrenamiento de Nvidia. Pero Google es un caso especial: controla su pila de software, lo que les permite adaptar las TPU con mucha precisión. Los otros hiperescaladores están más atrás.

Después de años de probar todo lo que hay en el mercado, Meta finalmente lanzó su propio acelerador, siguiendo a Microsoft que lanzó el suyo el año pasado. Ambas parecen interesantes, pero también son primeros intentos, y se necesitarán algunas generaciones para que estas soluciones demuestren su eficacia. Todo lo cual refuerza nuestra opinión de que ambos seguirán dependiendo en gran medida de Nvidia y AMD durante algunos años más.

Mientras tanto, AWS se encuentra en la segunda generación de sus chips de inferencia y entrenamiento, pero estos también están relativamente atrasados, y Amazon ahora parece estar luchando por comprar toda la producción de Nvidia que pueda. Sus necesidades surgen del hecho de que no controlan su pila de software; ejecutan el software de sus clientes, y esos clientes tienen una fuerte preferencia por Nvidia.

Redes

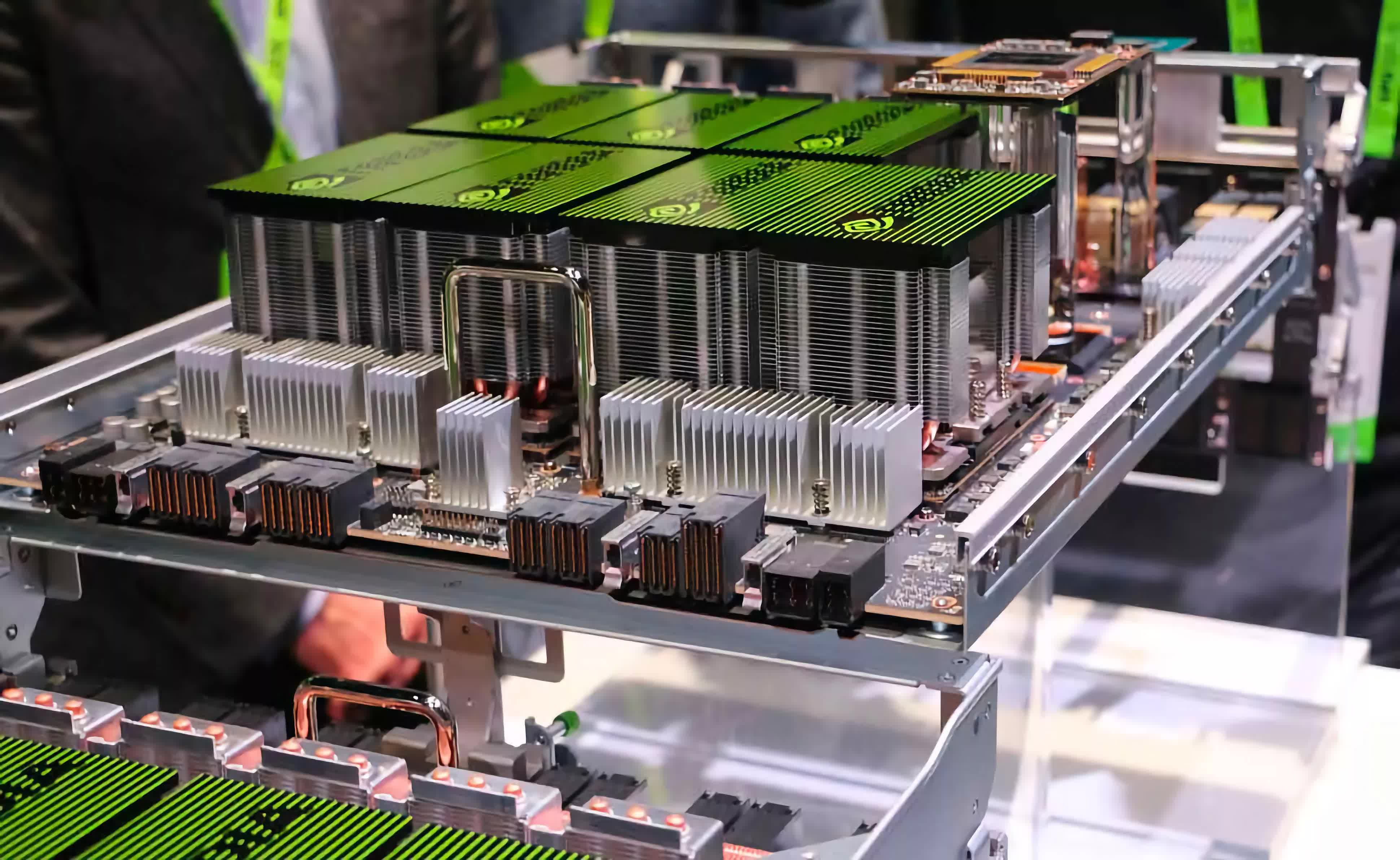

Otro elemento importante en todo esto es el hardware de red. Los enlaces entre todos los servidores de un centro de datos son una limitación importante para los modelos de IA. Nvidia tiene una gran ventaja en su pila de redes. Gran parte de esto proviene de la adquisición de Mellanox en 2019 y de su solución Infiniband de baja latencia.

Es probable que este acuerdo sea recordado como uno de los mejores acuerdos de fusiones y adquisiciones de la historia reciente. Sin embargo, esta ventaja es un arma de doble filo. Las ventas de sistemas completos de Nvidia hoy en día son una parte importante del crecimiento de sus ingresos y, en muchos casos de uso, las ventajas de esos sistemas se basan en gran medida en el elemento de red.

Es probable que la adquisición de Mellanox sea recordada como una de las mejores fusiones y adquisiciones de la historia reciente.

Recordar que Nvidia admitió La creación de redes es la fuente de su ventaja en el mercado de inferencia. Por el momento, Infiniband sigue siendo fundamental para las implementaciones de IA, pero la industria está invirtiendo un inmenso esfuerzo en la versión de baja latencia de Ethernet. Ultra Ethernet. Si Ultra Ethernet cumpliera su promesa, que de ninguna manera está garantizada, ejercería presión sobre Nvidia en algunas áreas importantes.

En resumen, Nvidia se enfrenta a una gran cantidad de competidores, pero se mantiene cómodamente por delante en calidad.

CUDA

Una gran razón de esta ventaja sigue siendo su pila de software. En realidad, el software de Nvidia tiene dos caras: su capa de compatibilidad «CUDA» y la creciente gama de servicios y modelos de software que ofrece a los clientes.

CUDA es el más conocido de ellos, a menudo citado como la base del liderazgo de la empresa en computación de IA. Creemos que esto simplifica demasiado la situación. CUDA es realmente una abreviatura de una gran cantidad de funciones en los chips Nvidia que los hacen programables hasta un nivel muy bajo. De todo lo que podemos ver, este foso sigue siendo increíblemente sólido.

La industria (por fin) está tomando conciencia del poder que proporciona esta capa de software y existen muchas iniciativas para ofrecer alternativas. Estos van desde ROCm de AMD hasta alternativas «abiertas» como XLA y UXL. Si desea profundizar en esto, escribió Austin Lyon. una excelente introducción a ChipStratque definitivamente vale la pena leer.

Pero el resumen rápido es que ninguno de ellos ha ganado mucha fuerza todavía, y la gran variedad de alternativas corre el riesgo de diluir los esfuerzos de todos; como de costumbre, XKCD lo dijo mejor. La heurística que hemos estado utilizando para evaluar estas alternativas es preguntar a los proponentes de cada una cuántos chips soportan el estándar actualmente. Cada vez que la respuesta avance más allá de un silencio incómodo, revisaremos esta posición. La mayor amenaza para Nvidia en este frente proviene de sus propios clientes. Los principales hiperescaladores están buscando formas de alejarse de CUDA, pero probablemente sean los únicos capaces de hacerlo.

Más software

Más allá de CUDA, Nvidia también está desarrollando un conjunto completo de otro software. Estos incluyen modelos previamente entrenados para unas pocas docenas de mercados finales, API de servicios componibles (NIM) y muchos otros.

Esto hace que sea mucho más fácil entrenar e implementar modelos de IA, siempre que esos modelos se ejecuten en silicio Nvidia. Todavía es temprano para la IA, y si Nvidia logra una adopción generalizada de éstas, efectivamente atraparán a una generación de desarrolladores cuyo software completo se basa en estos servicios. Hasta ahora, no está claro qué tan extendida está esa adopción. Sabemos que en algunos mercados, como el farmacéutico y el biotecnológico, existe un entusiasmo considerable por las herramientas de Nvidia, mientras que otros mercados aún se encuentran en las primeras fases de evaluación.

No está claro si Nvidia alguna vez planea cobrar por estos y hacer crecer un negocio de software real, lo que lleva a una pregunta fundamental más amplia sobre la competitividad de Nvidia. A medida que se vuelven más exitosas y prominentes, crece el nivel de incomodidad de la industria.

La cadena de suministro de los centros de datos ya está llena de quejas sobre los precios de Nvidia, su asignación de piezas escasas y sus largos plazos de entrega. Los clientes más grandes de Nvidia, los hiperescaladores, son muy cautelosos a la hora de depender demasiado de la empresa, especialmente porque Nvidia parece vacilar a punto de lanzar su propia oferta de infraestructura como servicio (IaaS).

¿Hasta dónde llegarán estos clientes y qué parte del stack de Nvidia comprarán? Tiene que haber un límite, pero las empresas a menudo pueden cortocircuitar el pensamiento estratégico a largo plazo en favor de descuentos y oportunidades de suministro a corto plazo. Los hiperescaladores no se habrían encontrado en esta posición si no hubieran abandonado a casi todas las startups que intentaron venderles una alternativa durante la última década. Entonces, Nvidia definitivamente enfrenta riesgos en este frente, pero por el momento, esos riesgos en gran medida no están definidos.

El modelo de negocio

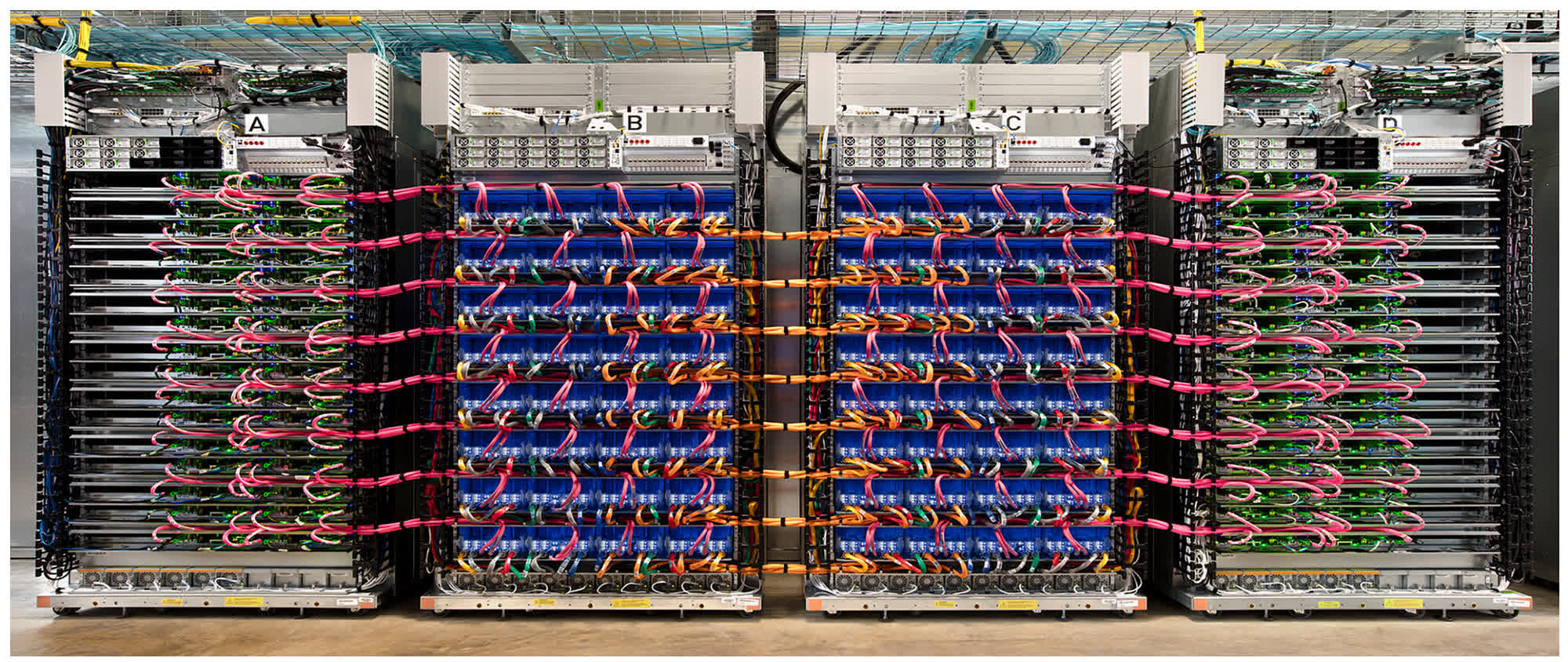

En términos más generales, creemos que existen desafíos para el modelo de negocio general de Nvidia. La empresa siempre ha vendido sistemas completos, desde tarjetas gráficas hace 30 años hasta los gigantescos bastidores de servidores DGX de la actualidad.

Por mucho que la empresa diga que está dispuesta a vender componentes descompuestos, claramente preferiría vender sistemas completos. Y esto plantea una serie de problemas. Como lo demuestra la historia de la compañía, cuando los ciclos de inventario bajan, Nvidia se encuentra al final del látigo, causando estragos en sus finanzas.

Jensen Huang (cofundador y director ejecutivo de NVIDIA) pic.twitter.com/e1tQkKKEZ5

– Hermanos de tecnología Dripted Out (@TechBroDrip) 13 de febrero de 2023

Dado el alcance de su reciente crecimiento y los sistemas cada vez más grandes que venden, el riesgo de un reinicio importante es mucho mayor. Para ser claros, no prevemos que esto suceda pronto, pero vale la pena considerar la magnitud del problema.

Infraestructura como servicio (IaaS)

Cual nos lleva a las fábricas de IA. En la actualidad hay aproximadamente una docena de operadores de centros de datos, independientes de los hiperescaladores IaaS de la nube pública, que ejecutan almacenes llenos de GPU Nvidia. Nvidia ha invertido en muchos de ellos y probablemente sean una importante fuente de ingresos dado que su propuesta de valor se basa en gran medida en su capacidad para ofrecer instancias de GPU bajo demanda.

Este es el canal de Nvidia y es probable que sea una fuente de problemas en el futuro. Para ser justos, existe una posibilidad remota de que la IA presente un cambio tan sísmico en la informática que las fábricas de IA se conviertan en los proveedores dominantes de IaaS, pero hay unas pocas empresas de billones de dólares que librarían una guerra de tierra arrasada para evitar que eso suceda.

IA de próxima generación

Finalmente, el riesgo final que se cierne sobre Nvidia es el crecimiento del aprendizaje automático basado en redes neuronales, también conocido como IA. Hasta ahora, el Los beneficios de la IA tienen un alcance bastante limitado – generación de código, marketing digital y una serie de pequeñas mejoras en el rendimiento del software internas.

Si quisiera construir un argumento bajista para Nvidia, debería explorar la posibilidad de que la IA no vaya más allá.

Si quisiera construir un argumento bajista para Nvidia, debería explorar la posibilidad de que la IA no vaya más allá. Creemos que eso es poco probable y nuestra sensación es que la IA aún puede avanzar mucho más, pero si no lo hace, Nvidia quedaría muy expuesta.

Del mismo modo (juego de palabras), el software de IA está cambiando tan rápidamente que es posible que algún futuro desarrollador genio presente un modelo de IA superior que cambie la computación en una dirección en la que las GPU y la inversión de Nvidia importen menos. Esto parece poco probable, pero todavía existe el riesgo de que el software de IA se estanque aquí o avance hasta el punto de desinflar la necesidad de tantos clústeres masivos de GPU en todo el mundo. Esto no debería verse como una catástrofe para Nvidia, pero provocaría una desaceleración significativa.

En resumen, Nvidia se encuentra en una posición muy fuerte, pero no inexpugnable.

En nuestra opinión, su mayor amenaza proviene de que tienen tanto éxito que obliga a sus clientes a responder. Hay múltiples futuros para Nvidia y el centro de datos, desde que Nvidia termina siendo solo uno de los muchos competidores en el centro de datos, hasta que Nvidia se convierte en la maestra del universo. Hay suficientes vulnerabilidades en su modelo para hacer improbable lo segundo, pero tienen tanto impulso que lo primero ya no es probable.